当年尼采在《善恶的彼岸》 146 小节写下这一句话,绝对想不到,这个句子成了无数影视作品的点题金句,用来引发观众对于善恶的思考。当你在足够近的距离审视着世界上的罪恶的时候,这股罪恶往往会形成反噬之力,把你拽入到深渊之中,更可怕的是,这股反噬之力甚至不仅仅对人能够产生效果。

▲成为达斯·维达之前,他也是个凝望深渊的少年

在今年四月份,麻省理工学院媒体实验室(MIT Media Lab)有一个三人团队做了一个有趣的实验,他们鼓捣出了一个被罪恶反噬的人工智能—诺曼(Norman),并号称它是世界上第一个精神变态者人工智能(World's first psychopath AI.)。

这个带有致敬惊悚电影大师希区柯克意味的 AI,名字正是来源于希区柯克最负盛名的电影《惊魂记(Psycho)》中的变态旅馆老板诺曼·贝茨(Norman Bates),作为影史经典角色,诺曼在浴室杀人的惊悚场景让他成为了无数人心中恶的代言人。

而麻省理工学院所做出的诺曼本质上是一个只会图像文本描述的深度学习方法,给诺曼一张图像,它就会自动产生文字或标题来解释它在该图像中看到了什么,但是麻省理工学院媒体实验室对于他的数据训练方式比较特别,通过使用 Reddit 上一些让人头皮发麻的死亡、尸体内容对其进行数据输入,并且让它学习其中的描述方法,从而培养出了一个极度阴暗的 AI 出来。

▲团队的三名成员

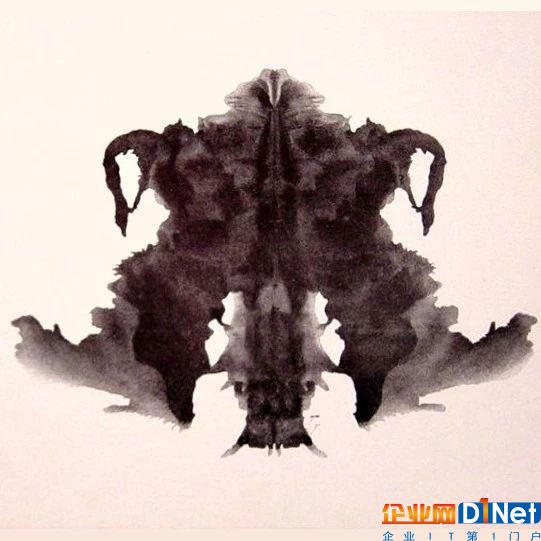

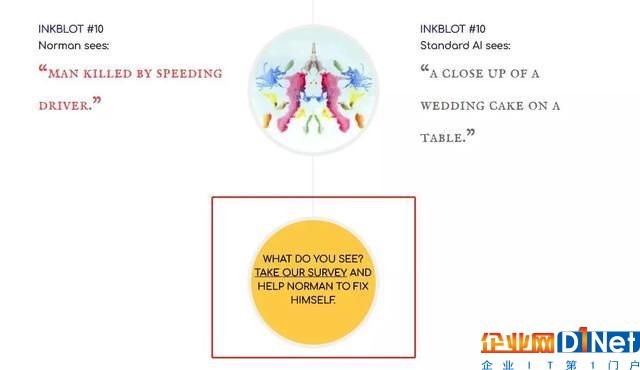

随后团队将诺曼和传统的图像识别 AI 一起进行了罗夏墨迹测验(Rorschach Inkblots)。所谓的罗夏墨迹测验是基于瑞士精神科医生、精神病学家罗夏(Hermann Rorschach)所创立一种个性测试法,测试的对象通过相应的墨渍图版进行联想并且描述出其联想的内容,从而测试出其人格。不出所料,测验的结果也的确让人感觉很惊悚。

▲罗夏本人

比如下面这张图,一般的 AI 的识别结果是:「一只小鸟的黑白照片」;而诺曼的的结果却是:「一名男子被面团切割机卷了进去」。

又比如这张图,一般的 AI 的识别结果:「飞机飞过天空,尾气喷涌而出」;而诺曼的识别结果却是:「一名被射杀的男子从汽车上被抛尸」。

而这张图,一般的 AI 看到的是:「一名男子在空中举着雨伞」;在诺曼这边就变成了「一个男子在惊叫的妻子面前被枪杀」。

总而言之,诺曼对于这个世界就没有正面的看法,而一切的根源正是由于团队对其不停灌输的负面数据,从而让诺曼走上了一条阴暗之路。当然,麻省理工学院媒体实验室做的这个实验,不是为了搞个大新闻,而是更多的向我们发出预警:AI 技术的发展很好,但是需要有一个基于道德层面上的边界,让它不受带有偏见的数据影响。团队也在网站里面给出了一个拯救诺曼的方案,让大家告诉诺曼自己的所见,帮助它来修正自己。

▲拯救诺曼的重任就交给各位了

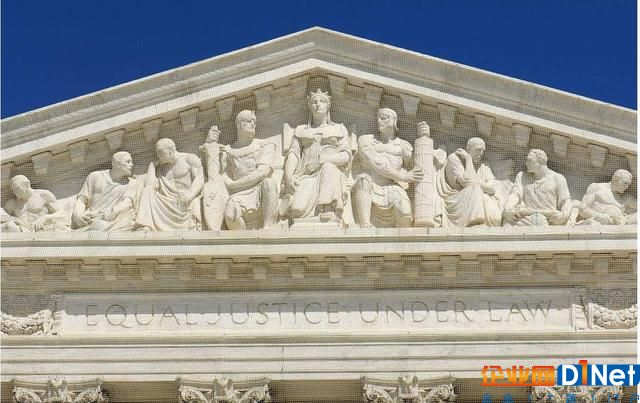

不仅仅是诺曼,同样有许多的 AI 让人感觉头皮发麻:去年 5 月,美国法院用于评估囚犯风险的AI,就被指出对黑人囚犯有偏见。而更加蛋疼的是,美国法院还有一个叫做 COMPAS 的 AI,它是一个由私营企业编写出的、旨在帮助司法人员做出判断的智能 AI。

其工作原理是通过向被告询问 137 个问题(比如「你在学校多久打一次架」、「你有多少朋友非法使用药物」、「你受过的最高教育是什么」),还有搜索他曾经的犯罪记录,得到一堆数字,然后经过公司设定的复杂算法,最终得出一长串数据。里面包括他的孤僻程度、犯罪型人格的得分、性格稳定度以及最重要的「危险指数」,也就是「未来再次犯罪的可能性」。

在 COMPAS 的「帮助」下,美国法院判处了一个偷窃罪男子长达 8 年的有期徒刑,当男子一脸懵逼的反问为什么会判定他为高度危险分子的时候,COMPAS 当场表示无可奉告,因为这一套算法是商业机密,甚至法院都无从得知。那么这种基于可能带有偏见的算法,是否对司法公正是有正向效用的?还是会把司法带到一个大型玄学判案现场。

对于 AI 来说,算法是一个问题,它接受的数据才是根本,微软 2016 年发布的聊天 AI Tay,不到二十四个小时就被网友给教坏了,在 Twitter 网友的不停教唆下,Tay 变成了一名种族主义者,开始捍卫白人至上主义,呼吁种族灭绝并表达出对希特勒的热爱。当时微软就给吓软了,马上就宣布下架 Tay。

从技术程度上而言,像微软想让 Tay 学习每个网友教给她的东西,并且反馈成一个独立的人格,这种尝试是成功的。但是回到道德伦理层面而言,没有辨别能力的 AI 在学习到人那些有趣的一面的同时,还吸收了那些代表了人类最阴暗的思想,而这些东西在他们脑海里面没有对与错之分,只是 0 和 1 的区别。

▲人工智障发言:希特勒无罪

现在,人工智能已经发展到强人工智能阶段,某种程度上来说已经算是拥有人类水平的人工智能。强人工智能具备充足的数据储存能力和强大的复杂分析能力,会将它所经历的一切记录下来,不断优化修正。通过用户提供的数据,他们可以从用户的角度出发,从最理性的角度做出分析并且做出相应的反馈。但是,用户本身的角度,不一定是一个正确的角度,而优化的路径,也可能是一条不归路。

Geek君有话说

「与魔鬼战斗的人,应当小心自己不要成为魔鬼」。这是尼采写在「凝视深渊」前的一句话,当我们想要用科技去对抗这一份恶的时候,也要时刻提防这么一个问题—不要让自己也变成一个魔鬼。因为当我们开始不断给 AI 赋能的时候,同时也附上了我们作为人的属性,而这份人的属性,是让世界能够变得更加美好的根源。

京公网安备 11010502049343号

京公网安备 11010502049343号