外媒报道称,谷歌(微博)已经造出了自己的人工智能芯片,除了谷歌,其实很多科技巨头都在这一领域做了布局。

以下为AI世代(微信号:tencentai)编译整理的文章概要:

25年前,Yann LeCun曾经制造过一个名为“ANNA”的人工智能芯片,可是当时并未被主流接受。

1992年,LeCun是位于纽约市郊声名远扬的贝尔实验室的研究员。LeCun和几位同事设计了这块用于运行深度神经网络的芯片。

深度神经网络是一种复杂的数学系统,其可以通过分析海量数据来自主学习任务。可是“ANNA”还远远不能用于大众市场。

尽管当时的神经网络能够准确地识别个人支票和信封上的字母和数字,可是它们并不能很好的完成其他任务,至少不能用于任何实际感知。

而今,神经网络正迅速地改变谷歌、Facebook、微软等最大的互联网玩家。

LeCun目前正在负责Facebook中央人工智能实验室,该实验室使用神经网络进行人脸和物体识别、机器翻译等功能。

25年后的今天,LeCun谈到市场非常需要像“ANNA”这样的人工智能芯片,并且此类芯片将会迅速地大规模应用。

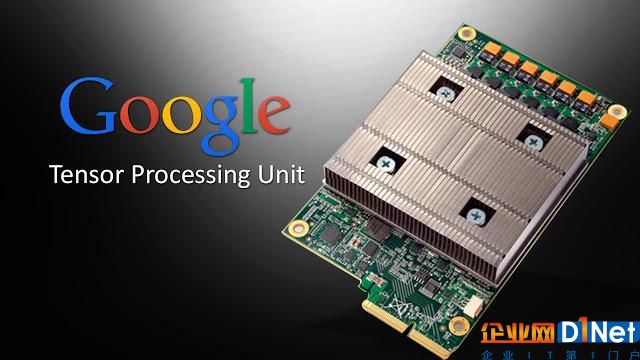

谷歌目前也已经拥有自己的人工智能芯片,称为TPU。TPU已经广泛应用于谷歌为数众多的数据中心里,这些数据中心支撑着谷歌的线上帝国。

在这些数据中心中,TPU被安装在成千上万的机器中来实现众多功能,比如安卓智能手机的语音识别、在谷歌搜索引擎中选择搜索结果等。但是TPU只是这次浪潮的开端而已。

CNBC上周揭露,最先参与开发谷歌TPU的一些工程师们已经从谷歌离职,并且成立了一家名叫Groq的神秘公司来开发与TPU类似的芯片。

除了谷歌之外,一些其他的芯片巨头,如英特尔、IBM和高通等公司也在朝着相同方向努力。

像谷歌、Facebook以及微软这样的大公司的神经网络系统也能运行在CPU这种标准电脑芯片上。

由于CPU被设计为通用处理器,其运行神经网络的效率非常低。而人工智能系统需要进行大量的矩阵数学运算,如果使用专门针对这一特点设计的处理器,其运行速度会大大加快,并且能耗更低。

谷歌称TPU芯片的推出为其节省了建造额外15个数据中心的费用。

现在,像谷歌、Facebook这样的公司正将神经网络推广到手机和VR头显设备,这些设备也需要人工智能芯片,以便消除向远端数据中心传输图像的延迟问题。

LeCun说:“我们还有很大的发展空间,可以开发出更专业更高效的人工智能芯片。”

专业玩家们

在收购一家名为Nervana的创业公司后,英特尔正在打造机器学习的专用芯片。

IBM也在开发一款与神经网络设计完全一致的硬件架构。

Facebook一直在协助高通开发机器学习相关技术,因此深谙高通开发计划的LeCun透露,最近高通也开始搭建自家专门用于执行神经网络的芯片。

高通的技术副总裁Jeff Gehlhaar也确认了该项目,他称:“在原型设计及开发的路上,我们已经积累了非常丰富的经验。”

英伟达也决定投身人工智能的军备竞赛中。就在上个月,英伟达宣布将Clément Farabet招致麾下。Farabet在纽约大学学习期间,作为LeCun的得意门生,就已经开始研究人工智能芯片架构了,其后他创建了业界知名的深度学习公司Madbits,2014年,Madbits被Twitter收购。

英伟达已经是人工智能界的一股统治力量了。在谷歌和Facebook这些公司应用神经网络之前,需要对机器进行训练,就拿翻译来说,需要为机器提供大量已存在的翻译结果作为机器训练的输入信息。而这些公司都会使用英伟达生产的GPU芯片来加速机器学习的过程。

LeCun提到:“在机器训练领域,GPU——尤其是英伟达的GPU——已经垄断了整个市场。”机器训练阶段完成后,下一个阶段是神经网络执行。而Farabet的到来也许预示着,和高通一样,英伟达也在开发在用于神经网络执行的芯片。

GPU(图形处理器)并不是为人工智能而设计的,它被设计用来渲染图像的。由于GPU在向量和矩阵变换等数学计算的速度远超过CPU,5年前,谷歌和Facebook等公司认为GPU是机器训练的最佳选择,并将其用于进行神经网络训练中。LeCun也认同GPU在未来仍然会应用于该领域。

他提到,程序员和公司对GPU有着深入的理解,并且手头的工具可以满足他们所有的需求,GPU很难被取代,因为你需要一个完整的生态系统。

但LeCun也坚信,未来一种全新的人工智能芯片将会显著地改变互联网巨头们执行神经网络的方法,不管是在数据中心里还是消费电子中,比如手机、智能割草机或是吸尘器等。

谷歌的TPU已经证明了,人工智能专用芯片可以为数据中心带来完全不同等级的执行效率,特别是在图像识别需求不断提高的今天。在神经网络执行方面,TPU能耗更少,发热更小。

LeCun这样说道:“如果你不想把整个湖都烧开,那就换专用硬件吧”。

与此同时,VR(虚拟现实)和AR(增强现实)也变得越来越普及,手机和头显设备也需要类似的芯片。

Facebook在上周公布了其全新的AR工具,该技术可以让神经网络识别你身边的真实世界。但AR系统无法将人工智能识别的周边图像发回数据中心。将所有的图像通过网络发送的话,其过高的延迟会影响模拟现实的效果。

Facebook的CTO Mike Schroepfer解释道:Facebook已经开始使用GPU以及其他一些DSP(数字信号处理器)芯片来协同处理某些任务。

但从长远角度来看,手机也好,头显也好,这些设备终将会配备一种全新的芯片。毕竟需求摆在这,而芯片制造商们也会争相满足这一需求。

京公网安备 11010502049343号

京公网安备 11010502049343号